CAPTCHA somos nosotros: El valor invisible detrás de la verificación humana

Analizamos cómo los sistemas de verificación no sirven solo a la seguridad, sino que transforman a los usuarios en fuerza laboral para el entrenamiento de inteligencias artificiales. Una exploración del delicado equilibrio entre protección de datos, experiencia de usuario y el valor no declarado de nuestras interacciones digitales.

CAPTCHA somos nosotros

Cada día, millones de veces al día, el flujo digital global se interrumpe por una fracción de segundo. Ante una pantalla de inicio de sesión o un formulario de contacto, se nos pide identificar semáforos, pasos de peatones, bocas de incendio o bicicletas pixeladas. Lo que percibimos como una medida de seguridad trivial es, en realidad, una de las mayores operaciones de trabajo colectivo distribuido jamás realizadas. En GoBooksy, al trabajar diariamente en la arquitectura de flujos de datos y en la interacción con el usuario, observamos constantemente cómo este mecanismo no es simplemente una puerta de acceso, sino un intercambio de valor a menudo desequilibrado. No estamos solo demostrando ser humanos; estamos prestando nuestra capacidad cognitiva para enseñar a las máquinas a ver el mundo como nosotros.

La realidad operativa que encontramos en la gestión de infraestructuras web nos muestra que el concepto clásico del test de Turing se ha invertido por completo. Inicialmente, estas pruebas servían para digitalizar libros que los sistemas de reconocimiento óptico no lograban leer. Cada vez que un usuario descifraba una palabra distorsionada, estaba literalmente salvando un fragmento de archivo analógico. Hoy, la naturaleza de las imágenes que se nos proponen ha cambiado radicalmente porque han cambiado las necesidades de las inteligencias artificiales que requieren entrenamiento. Cuando seleccionamos todos los recuadros que contienen un autobús, estamos refinando los algoritmos de conducción autónoma, enseñando a los vehículos a distinguir obstáculos urbanos con la precisión que solo el ojo humano posee todavía en determinadas condiciones de ambigüedad visual.

Esta dinámica introduce una fricción notable en la experiencia del usuario, un problema que enfrentamos a menudo cuando diseñamos interfaces para nuestros clientes. Existe un punto de ruptura sutil pero tangible: cuando la seguridad se vuelve demasiado invasiva, el usuario abandona la navegación. Hemos notado que la implementación agresiva de desafíos visuales reduce drásticamente las tasas de conversión, creando frustración en quien simplemente busca acceder a un servicio legítimo. La paradoja es que los bots, esos softwares automáticos que estos sistemas deberían bloquear, se han vuelto tan sofisticados que resuelven los rompecabezas visuales con una velocidad y precisión a menudo superiores a las humanas. En consecuencia, para mantener la eficacia, las pruebas se han vuelto progresivamente más difíciles para las personas reales, llegando a proponer imágenes tan confusas o culturalmente específicas que resultan incomprensibles.

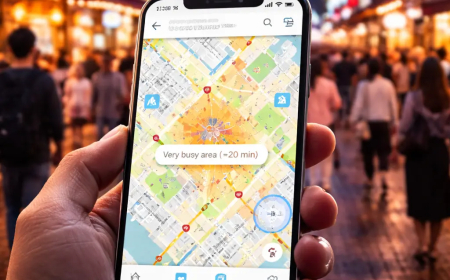

La evolución tecnológica está afortunadamente desplazando el eje hacia una verificación invisible, basada no en lo que el usuario sabe resolver, sino en cómo se comporta. En los sistemas que monitoreamos e integramos en el ecosistema GoBooksy, privilegiamos cada vez más el análisis biométrico conductual. Este enfoque evalúa el movimiento del ratón, la aceleración del cursor, los tiempos de reacción e incluso las micro-vacilaciones que son intrínsecamente humanas y dificilísimas de replicar para un algoritmo programado. Ya no pedimos al usuario que trabaje para el sistema; dejamos que sea el sistema el que comprenda la naturaleza del usuario a través del análisis de patrones de navegación. Si bien esto mejora la usabilidad eliminando interrupciones, también abre cuestiones profundas sobre la privacidad y el rastreo constante, ya que la verificación se convierte en un proceso continuo y silencioso, no en un obstáculo único a superar.

Sigue siendo fundamental comprender que la seguridad total en la web es una ilusión, y la gestión del riesgo debe ser equilibrada. A menudo intervenimos para recalibrar sistemas defensivos que, en el intento de excluir cualquier posible amenaza automatizada, terminan excluyendo segmentos de usuarios legítimos, quizás aquellos que utilizan tecnologías de asistencia o navegan desde conexiones compartidas con reputación mixta. El desafío técnico no es erigir muros más altos, sino construir filtros más inteligentes que sepan distinguir la intención maliciosa del comportamiento humano genuino, incluso cuando este último es imperfecto o impredecible.

El futuro de la verificación de la identidad online se está alejando de la solicitud de pruebas cognitivas explícitas para acercarse a un modelo de confianza reputacional. En este escenario, GoBooksy continúa observando y adaptando sus tecnologías conscientes de que cada clic en una imagen, o cada segundo de vacilación del ratón, es un dato valioso. Hemos pasado de ser simples usuarios a convertirnos, inconscientemente, en los validadores finales de la realidad para las máquinas que estamos construyendo. La próxima vez que el sistema nos pida confirmar nuestra humanidad, sabremos que no solo está controlando quiénes somos, sino que está aprendiendo de nosotros cómo ser un poco más humano él mismo.