CAPTCHA sind wir: Die unsichtbare Arbeit hinter der menschlichen Verifizierung

Wir analysieren, wie Verifizierungssysteme nicht nur der Sicherheit dienen, sondern Nutzer in Arbeitskräfte für das Training künstlicher Intelligenz verwandeln. Eine Untersuchung des empfindlichen Gleichgewichts zwischen Datenschutz, Benutzererfahrung und dem unausgesprochenen Wert unserer digitalen Interaktionen.

CAPTCHA sind wir

Jeden Tag, millionenfach, wird der globale digitale Fluss für den Bruchteil einer Sekunde unterbrochen. Vor einem Anmeldebildschirm oder einem Kontaktformular werden wir aufgefordert, Ampeln, Zebrastreifen, Hydranten oder verpixelte Fahrräder zu identifizieren. Was wir als triviale Sicherheitsmaßnahme wahrnehmen, ist in Wirklichkeit eine der größten Operationen verteilter kollektiver Arbeit, die je realisiert wurden. Bei GoBooksy, wo wir täglich an der Architektur von Datenströmen und Benutzerinteraktionen arbeiten, beobachten wir ständig, dass dieser Mechanismus keineswegs ein einfaches Eingangstor ist, sondern ein oft unausgewogener Werteaustausch. Wir beweisen nicht nur, dass wir Menschen sind; wir leihen unsere kognitiven Fähigkeiten, um Maschinen beizubringen, die Welt so zu sehen wie wir.

Die operative Realität, die wir beim Management von Webinfrastrukturen vorfinden, zeigt uns, dass das klassische Konzept des Turing-Tests vollständig umgekehrt wurde. Ursprünglich dienten diese Tests dazu, Bücher zu digitalisieren, die optische Erkennungssysteme nicht lesen konnten. Jedes Mal, wenn ein Benutzer ein verzerrtes Wort entzifferte, rettete er buchstäblich ein Stück analoges Archiv. Heute hat sich die Natur der Bilder, die uns vorgelegt werden, radikal verändert, weil sich die Bedürfnisse der künstlichen Intelligenzen, die Training benötigen, geändert haben. Wenn wir alle Felder auswählen, die einen Bus enthalten, verfeinern wir Algorithmen für autonomes Fahren und bringen Fahrzeugen bei, städtische Hindernisse mit der Präzision zu unterscheiden, die nur das menschliche Auge unter bestimmten Bedingungen visueller Mehrdeutigkeit noch besitzt.

Diese Dynamik führt zu einer erheblichen Reibung in der Benutzererfahrung, ein Problem, mit dem wir oft konfrontiert sind, wenn wir Schnittstellen für unsere Kunden entwerfen. Es gibt einen subtilen, aber spürbaren Bruchpunkt: Wenn die Sicherheit zu invasiv wird, bricht der Nutzer die Navigation ab. Wir haben festgestellt, dass die aggressive Implementierung visueller Herausforderungen die Konversionsraten drastisch senkt und Frustration bei denjenigen erzeugt, die einfach nur auf einen legitimen Dienst zugreifen wollen. Das Paradoxon ist, dass Bots – jene automatische Software, die diese Systeme blockieren sollen – so ausgefeilt geworden sind, dass sie visuelle Rätsel oft schneller und präziser lösen als Menschen. Um die Effektivität aufrechtzuerhalten, sind die Tests für echte Personen daher zunehmend schwieriger geworden und bieten Bilder an, die so verwirrend oder kulturell spezifisch sind, dass sie unverständlich erscheinen.

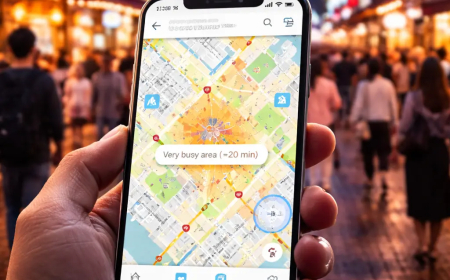

Die technologische Entwicklung verschiebt die Achse glücklicherweise hin zu einer unsichtbaren Verifizierung, die nicht darauf basiert, was der Nutzer lösen kann, sondern wie er sich verhält. In den Systemen, die wir überwachen und in das GoBooksy-Ökosystem integrieren, bevorzugen wir zunehmend die verhaltensbiometrische Analyse. Dieser Ansatz bewertet Mausbewegungen, Cursorbeschleunigung, Reaktionszeiten und sogar das mikroskopische Zögern, das intrinsisch menschlich ist und für einen geskripteten Algorithmus extrem schwer zu replizieren ist. Wir bitten den Nutzer nicht mehr, für das System zu arbeiten; wir lassen das System die Natur des Nutzers durch die Analyse von Navigationsmustern verstehen. Während dies die Benutzerfreundlichkeit durch die Beseitigung von Unterbrechungen verbessert, wirft es auch tiefgreifende Fragen zu Privatsphäre und ständiger Nachverfolgung auf, da die Verifizierung zu einem kontinuierlichen und stillen Prozess wird und nicht mehr ein einzelnes Hindernis darstellt.

Es bleibt grundlegend zu verstehen, dass absolute Sicherheit im Web eine Illusion ist und das Risikomanagement ausgewogen sein muss. Oft greifen wir ein, um Verteidigungssysteme neu zu kalibrieren, die beim Versuch, jede mögliche automatisierte Bedrohung auszuschließen, am Ende Segmente legitimer Nutzer ausschließen, vielleicht solche, die assistive Technologien verwenden oder von geteilten Verbindungen mit gemischter Reputation surfen. Die technische Herausforderung besteht nicht darin, höhere Mauern zu errichten, sondern intelligentere Filter zu bauen, die bösartige Absichten von echtem menschlichen Verhalten unterscheiden können, selbst wenn letzteres unvollkommen oder unvorhersehbar ist.

Die Zukunft der Identitätsprüfung online bewegt sich weg von der Anforderung expliziter kognitiver Beweise hin zu einem Modell des Reputationsvertrauens. In diesem Szenario beobachtet und passt GoBooksy seine Technologien weiterhin an, im Bewusstsein, dass jeder Klick auf ein Bild oder jede Sekunde des Zögerns der Maus ein wertvolles Datum ist. Wir haben uns von einfachen Nutzern unbewusst zu den endgültigen Validatoren der Realität für die Maschinen entwickelt, die wir bauen. Wenn das System uns das nächste Mal bittet, unsere Menschlichkeit zu bestätigen, wissen wir, dass es nicht nur prüft, wer wir sind, sondern von uns lernt, selbst ein bisschen menschlicher zu sein.